在人工智能技术飞速发展的今天,AI项目已不再局限于云端与数据中心,正加速向边缘侧延伸,形成“云边端”协同的智能体系。本文将系统梳理一个完整AI项目的核心流程,并深入解析人工智能基础软件开发,特别是边缘设备开发的关键技术与实践路径。

一、AI项目全流程概览

一个典型的AI项目通常遵循“需求分析-数据准备-模型开发-部署运维”的闭环流程。

- 需求分析与问题定义:明确业务场景(如工业质检、智能安防)、性能指标(精度、延迟、功耗)及约束条件(成本、功耗、离线要求)。这是决定项目技术选型与成败的起点。

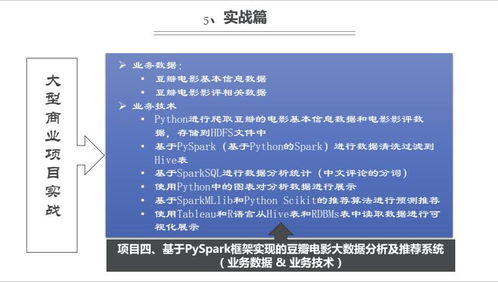

- 数据采集与处理:数据是AI的燃料。需收集代表性数据,进行清洗、标注(图像分类、目标检测等),并划分为训练集、验证集与测试集。数据质量直接决定模型上限。

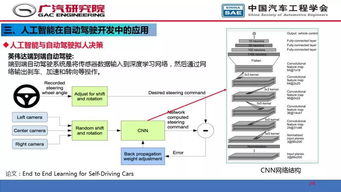

- 模型选择与训练:根据任务类型(分类、检测、分割等)选择合适模型(如CNN、YOLO、Transformer)。在云端或高性能服务器上进行训练,通过迭代优化损失函数,提升模型精度。

- 模型优化与压缩:为适配边缘设备资源限制(算力、内存有限),常需对模型进行剪枝、量化、知识蒸馏等优化,在精度与效率间取得平衡。

- 部署与集成:将优化后的模型部署到目标边缘设备(如嵌入式板卡、工控机、摄像头),编写推理代码,并与硬件驱动、业务逻辑集成,形成完整应用。

- 测试、监控与迭代:在真实场景测试性能,持续监控模型漂移与设备状态,收集新数据触发模型迭代更新,形成持续优化闭环。

二、人工智能基础软件开发核心

基础软件是衔接算法与硬件的桥梁,尤其在边缘侧,需重点关注:

- 推理框架:如TensorFlow Lite、PyTorch Mobile、ONNX Runtime,提供跨平台模型部署能力,支持CPU/GPU/NPU异构计算。

- 硬件加速库:针对特定芯片(如英伟达Jetson、华为昇腾、瑞芯微等)的SDK(如TensorRT、CANN),充分释放硬件算力。

- 中间件与操作系统适配:在Linux、RTOS或容器环境中管理任务调度、内存、功耗,确保实时性与稳定性。

三、边缘设备开发实战要点

边缘设备开发面临资源受限、环境多变等挑战,需掌握以下关键技术:

- 跨平台移植:使用CMake等工具管理工程,编写可移植的C++/Python推理代码,适配不同架构(ARM、x86、RISC-V)。

- 性能优化:利用多线程、流水线、内存复用提升吞吐量;使用INT8量化、算子融合降低延迟;优化功耗策略延长设备续航。

- 端侧部署模式:

- 纯端侧推理:模型完全运行于设备,无网络依赖,适合实时性要求高或网络不可靠场景。

- 云边协同:轻量模型在端侧运行,复杂分析或重训练在云端执行,兼顾实时与智能。

- 开发与调试工具链:借助性能分析器(如perf、Nsight)、日志系统及远程调试工具,快速定位瓶颈。

四、趋势展望

随着AI芯片算力提升及开源生态成熟,边缘AI正朝着“更低成本、更低功耗、更高集成度”演进。自动机器学习(AutoML)将降低模型开发门槛,而联邦学习等隐私计算技术有望在边缘侧实现数据“可用不可见”,进一步拓展AI应用边界。

###

从云端训练到边缘部署,AI项目是一个融合算法、软件、硬件的系统工程。开发者需兼具全栈视角与深度优化能力,方能在“白夜”般清晰的技术路径中,打造出真正可用、可靠、高效的边缘智能产品。